Self-Supervised Surround-View Depth Estimation with Volumetric Feature Fusion

2023, Mar 18

- 논문 : https://openreview.net/forum?id=0PfIQs-ttQQ

- 발표 자료 : https://nips.cc/virtual/2022/poster/54283

- 이번 글에서는

NIPS 2022에 발표된Self-Supervised Surround-View Depth Estimation with Volumetric Feature Fusion논문에 대한 내용 리뷰를 진행하겠습니다. - 논문에서 주목하고자 하는 부분은 멀티 카메라를 사용하였을 때 카메라 간 겹치는 영역이 발생하는데 그 영역에 대하여 어떻게 Fusion을 잘 할 지에 대한 방법과 그 효과를 보여줍니다. 이 방법을 논문에서는

Volumetric Feature Fusion이라고 명하였습니다.

목차

-

Abstract

-

Introduction

-

Related Work

-

Surround-View Depth Estimation via Volumetric Feature Fusion

-

Experiments

-

Conclusions

-

Supplementary

-

42dot dataset

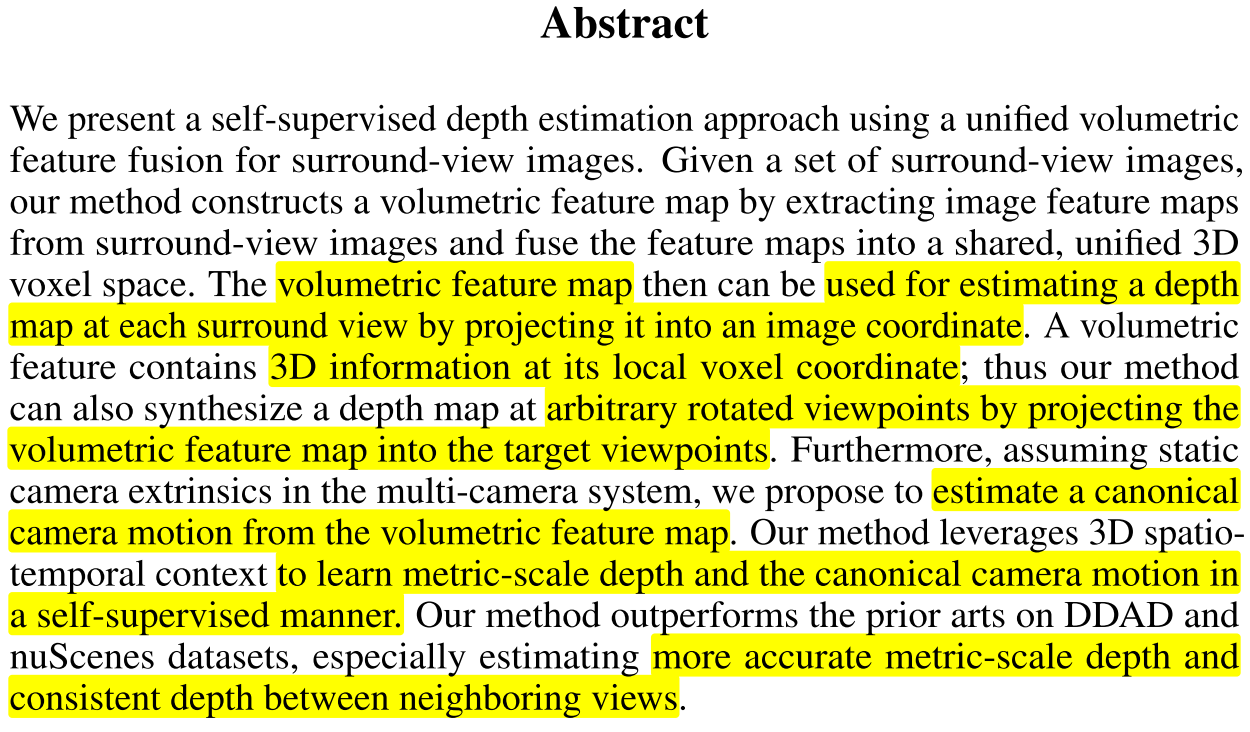

Abstract

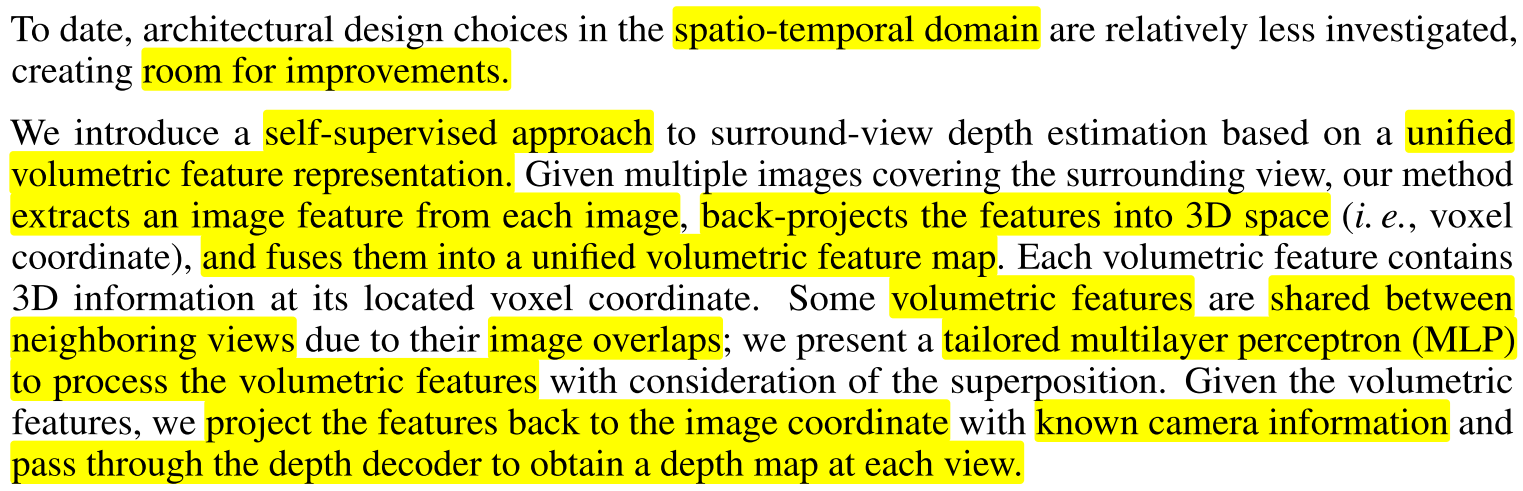

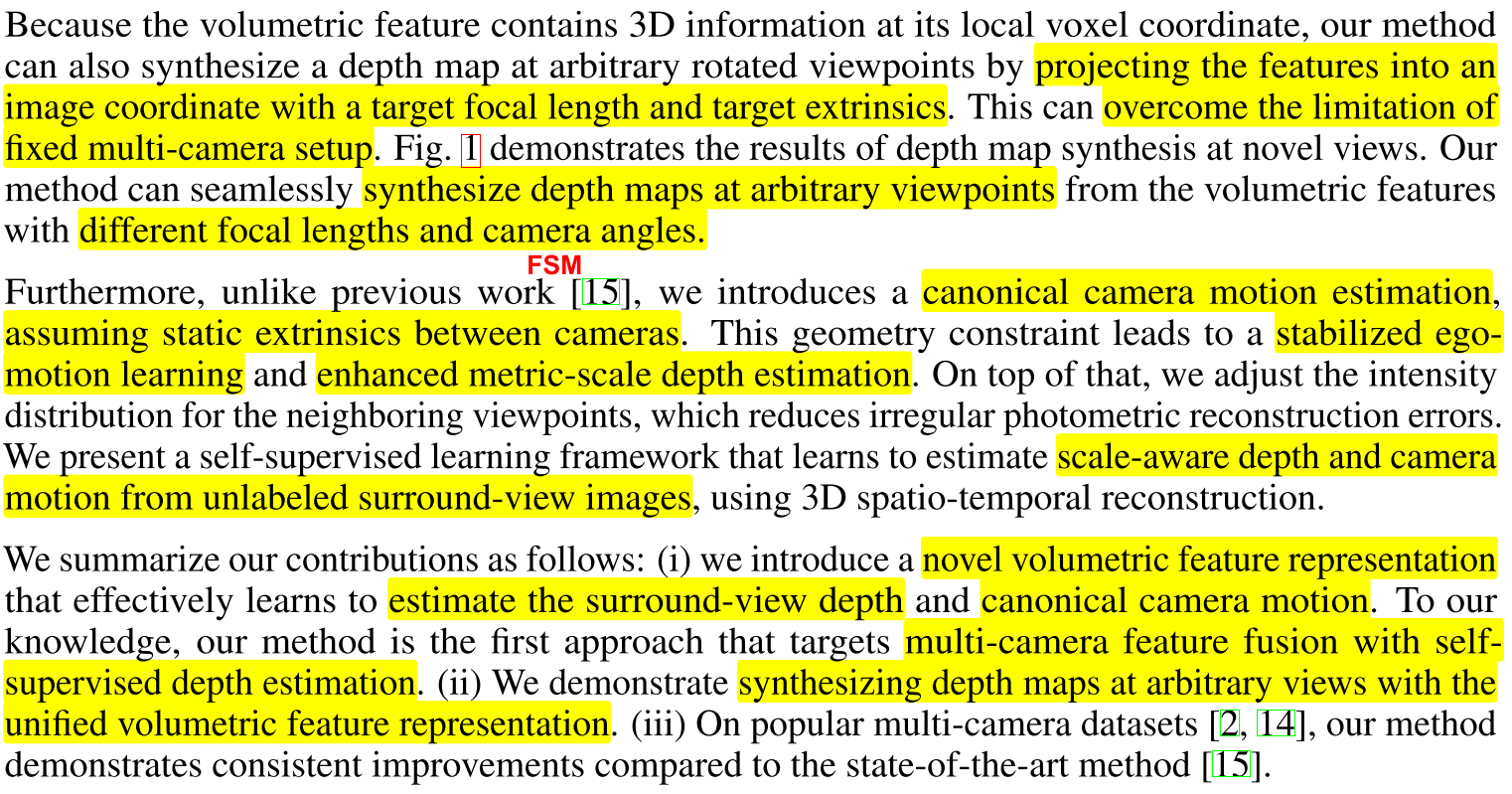

Introduction

Related Work

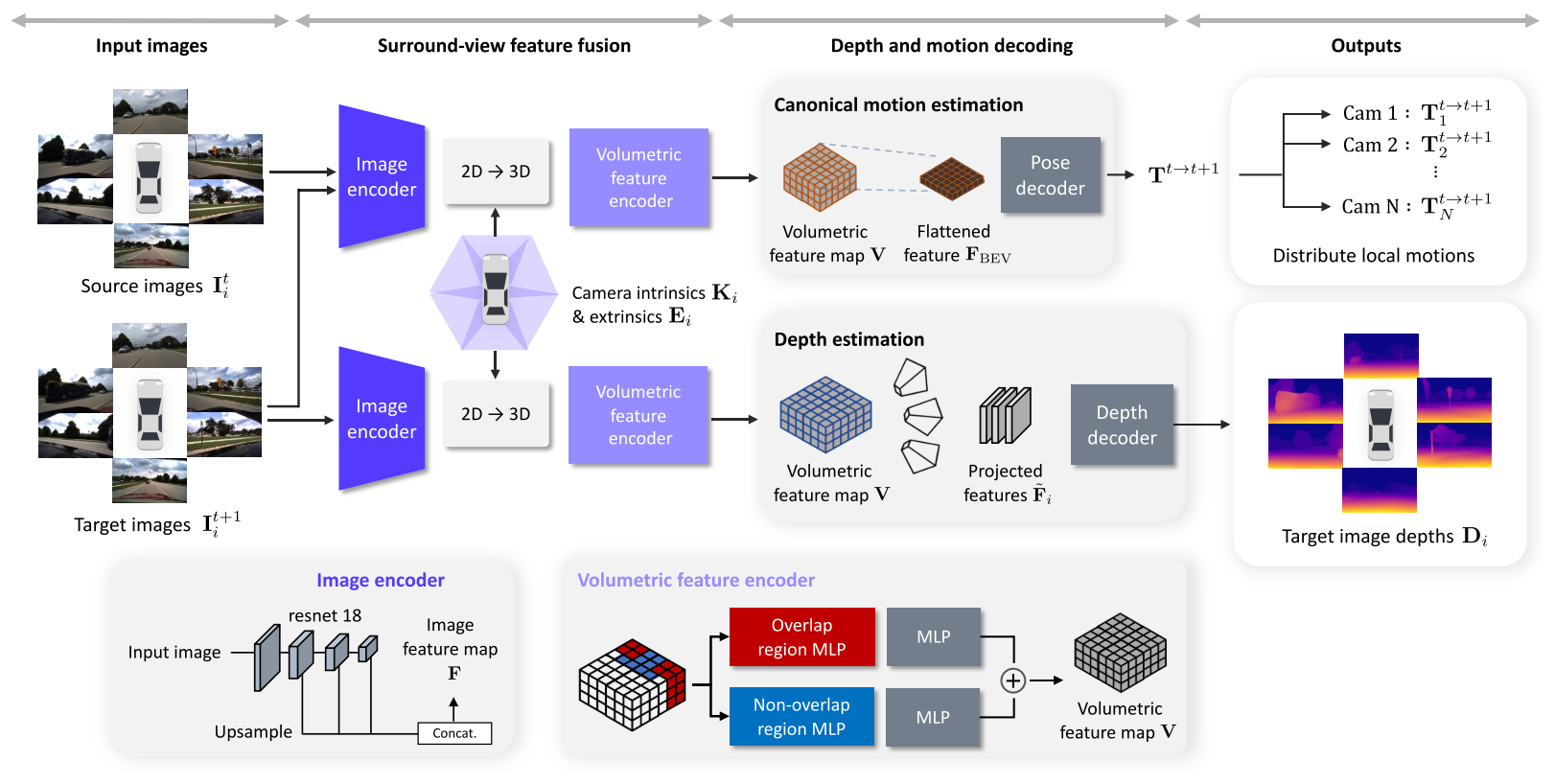

Surround-View Depth Estimation via Volumetric Feature Fusion

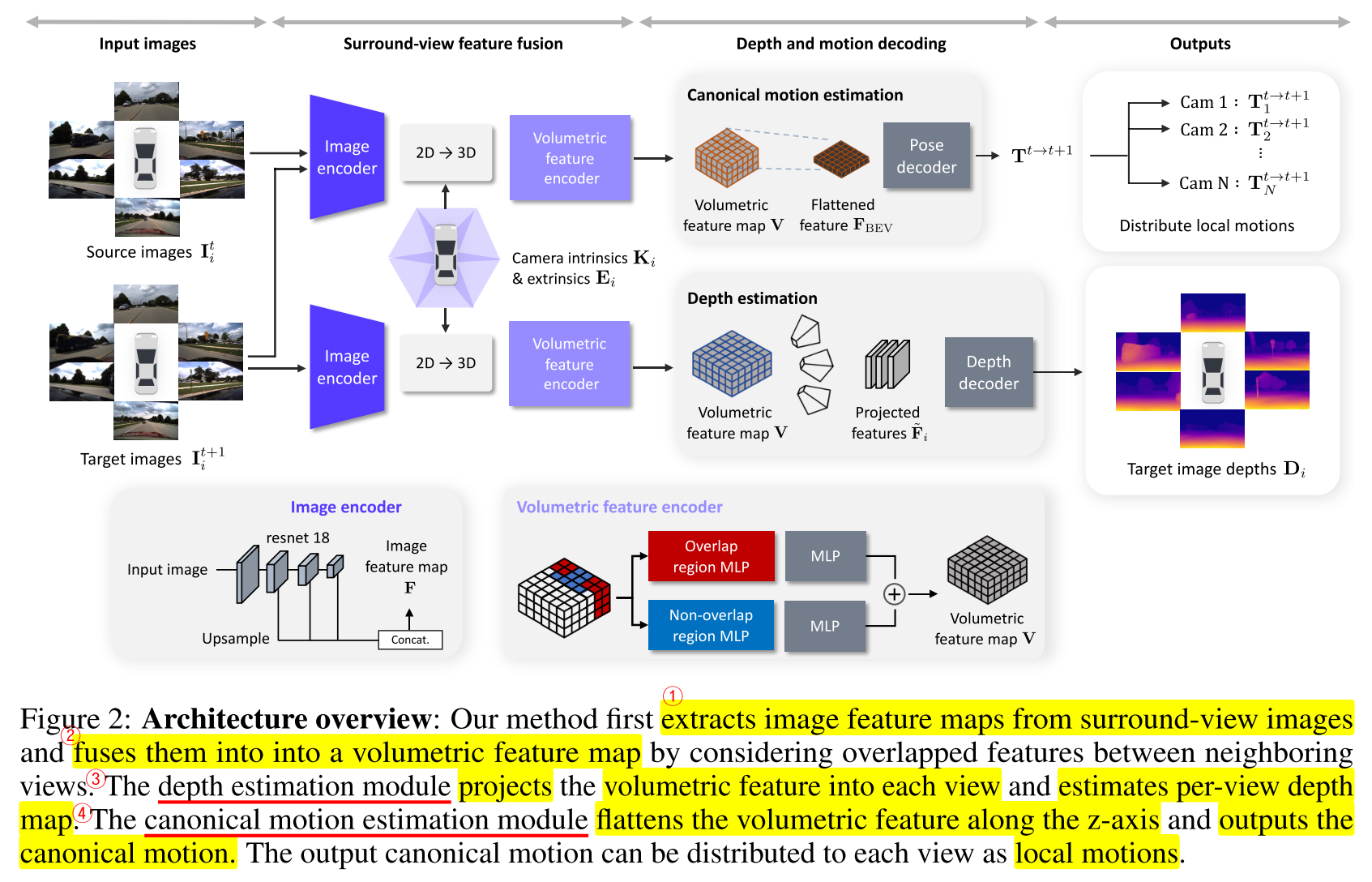

Architecture overview

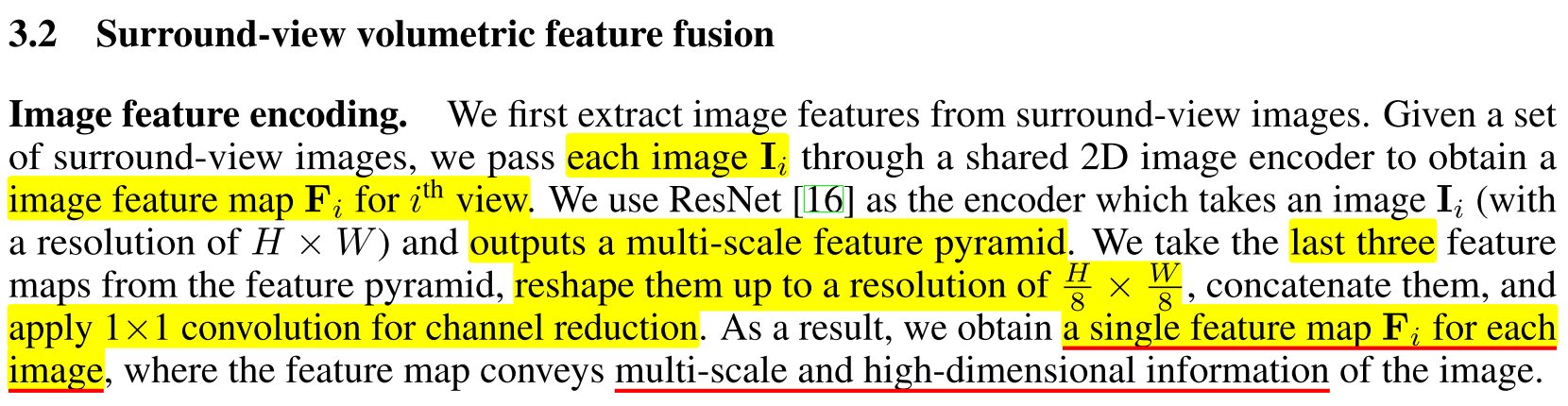

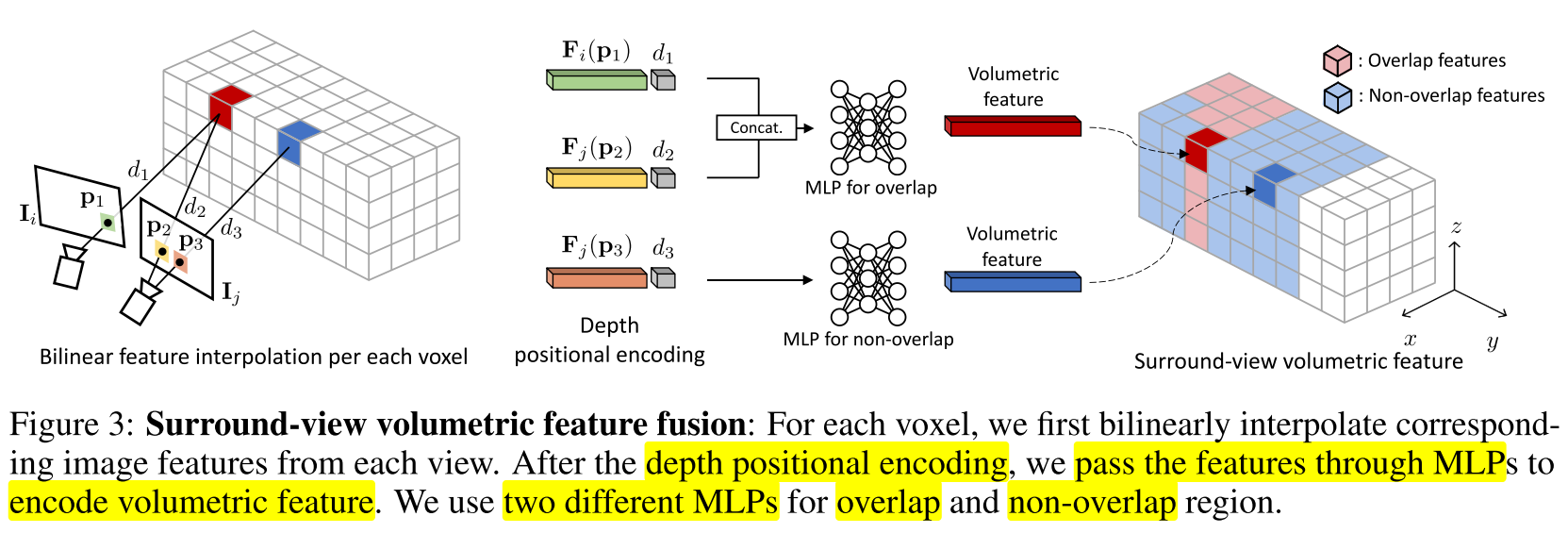

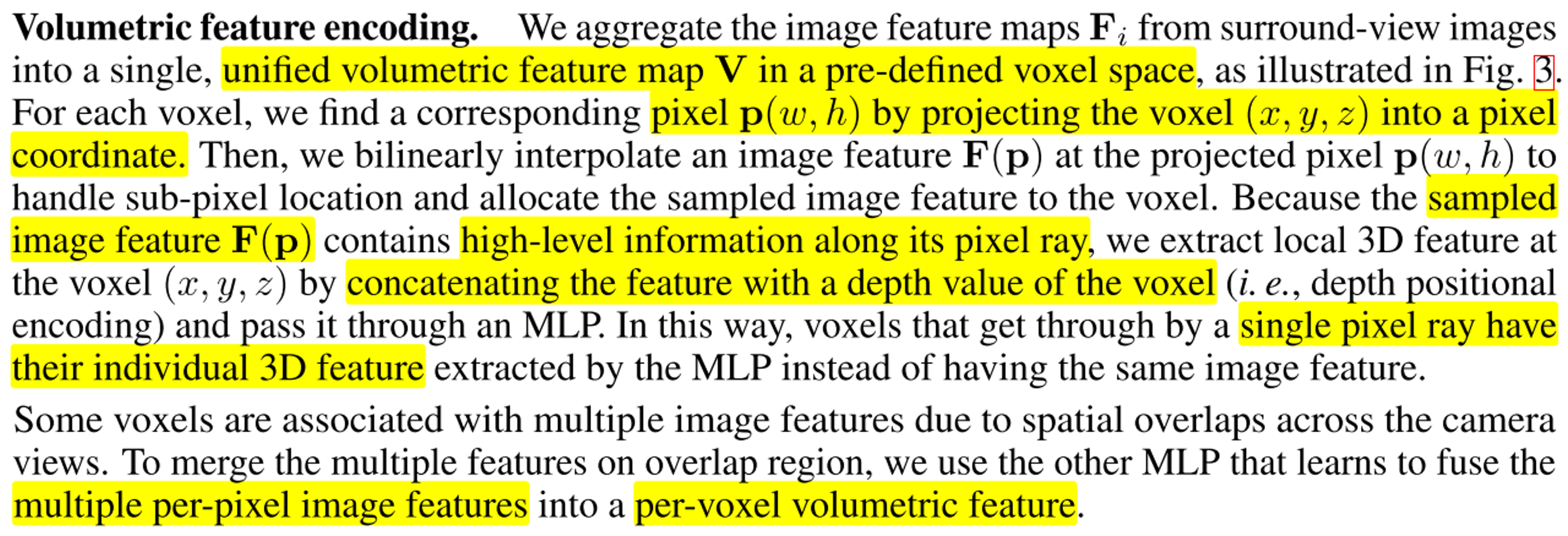

Surround-view volumetric feature fusion

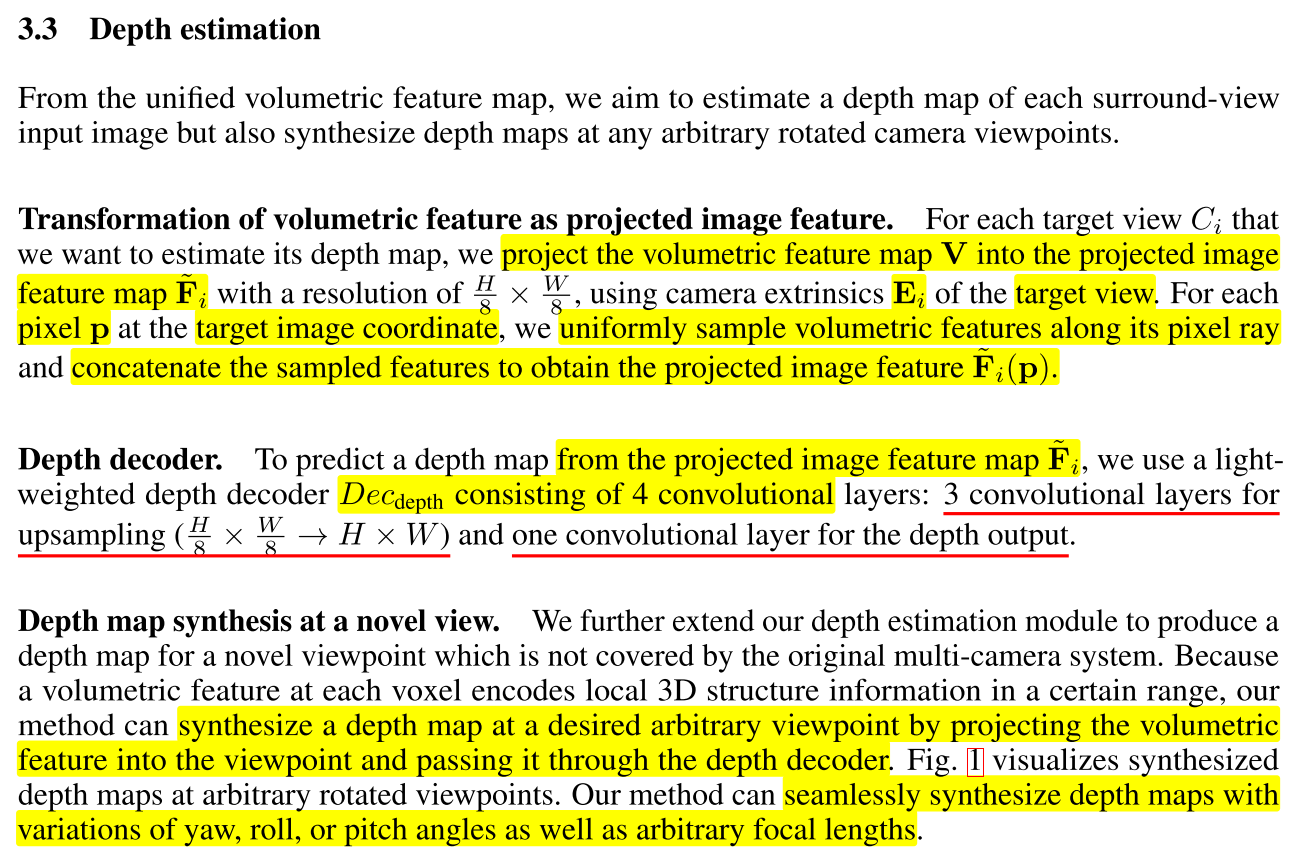

Depth Estimation

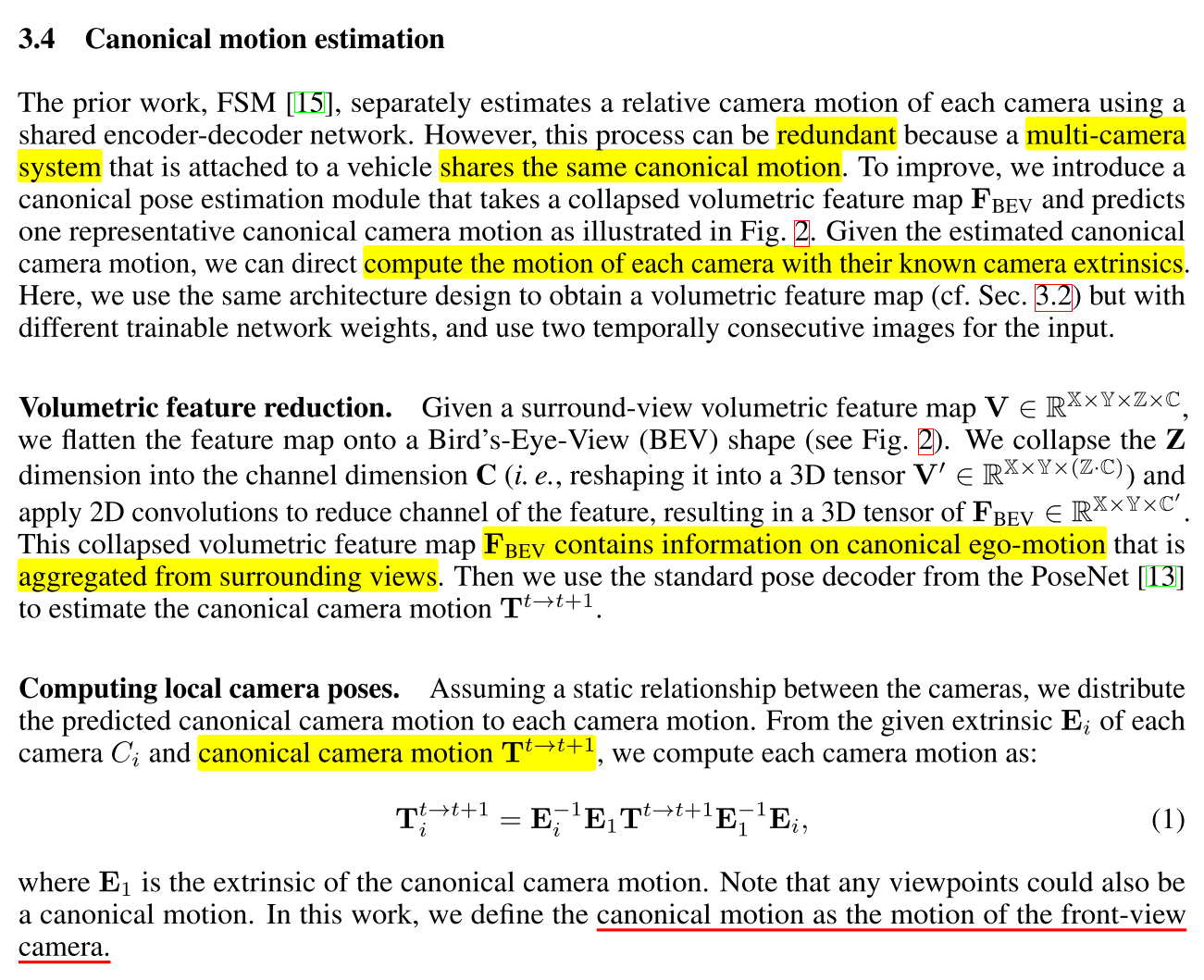

Canonical motion estimation

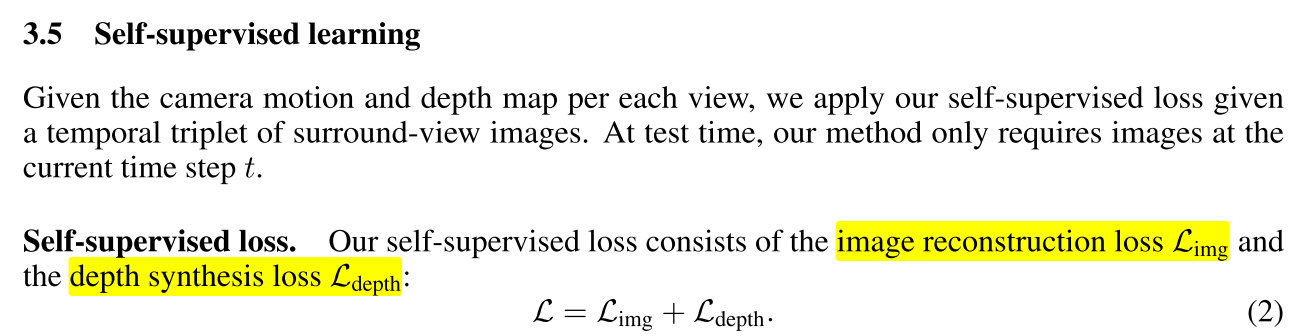

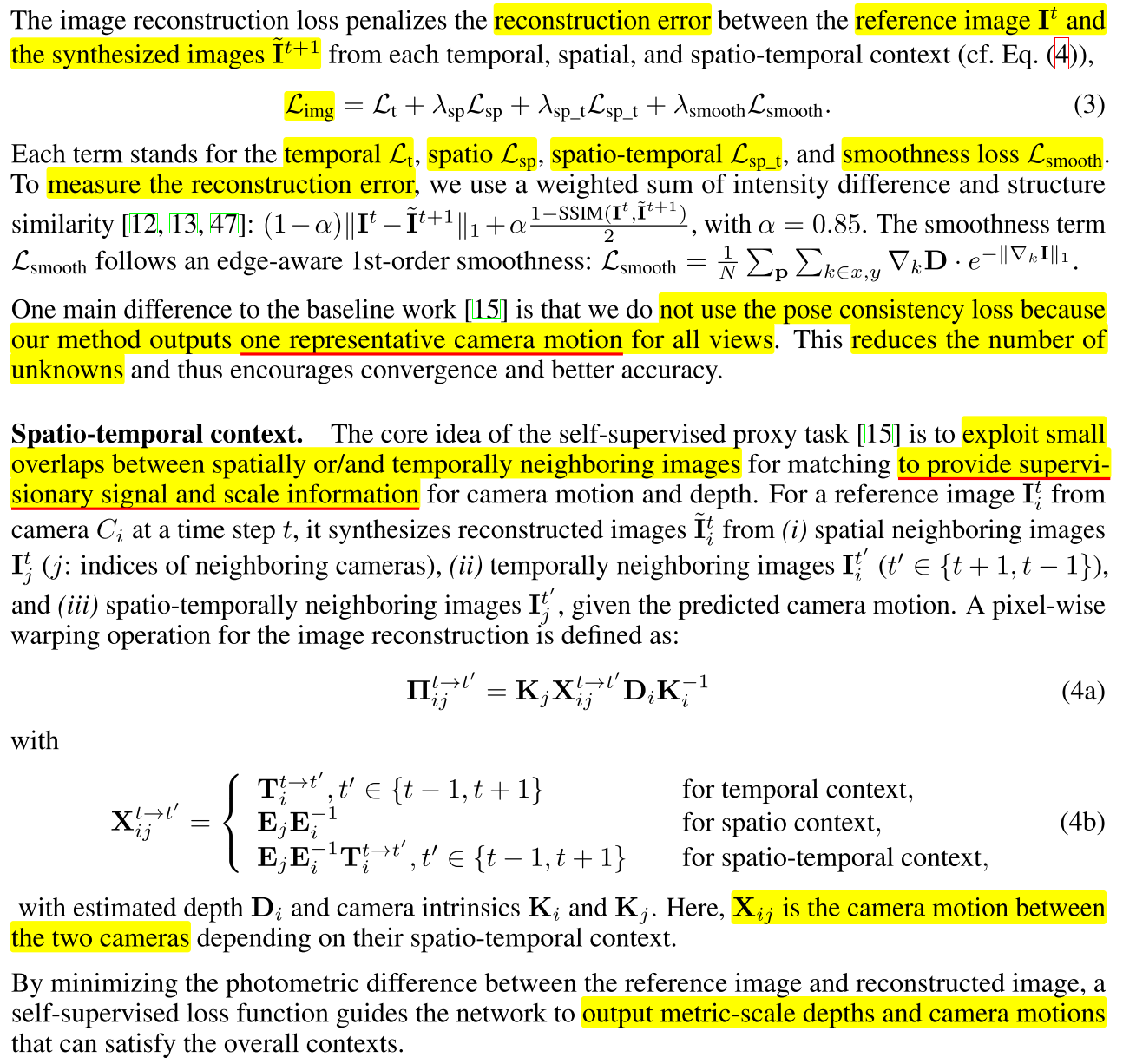

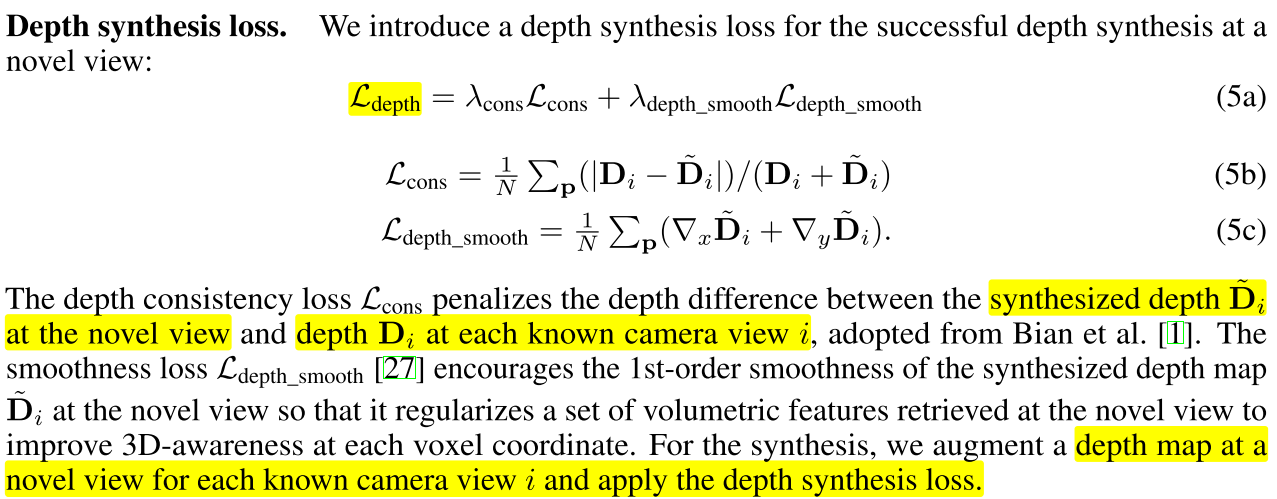

Self-supervised learning

Experiments

Conclusions

Supplementary

42dot dataset

- 아래 링크에서 42dot 데이터셋을 받아볼 수 있습니다.

- 링크 : https://www.42dot.ai/akit/dataset/mcmot

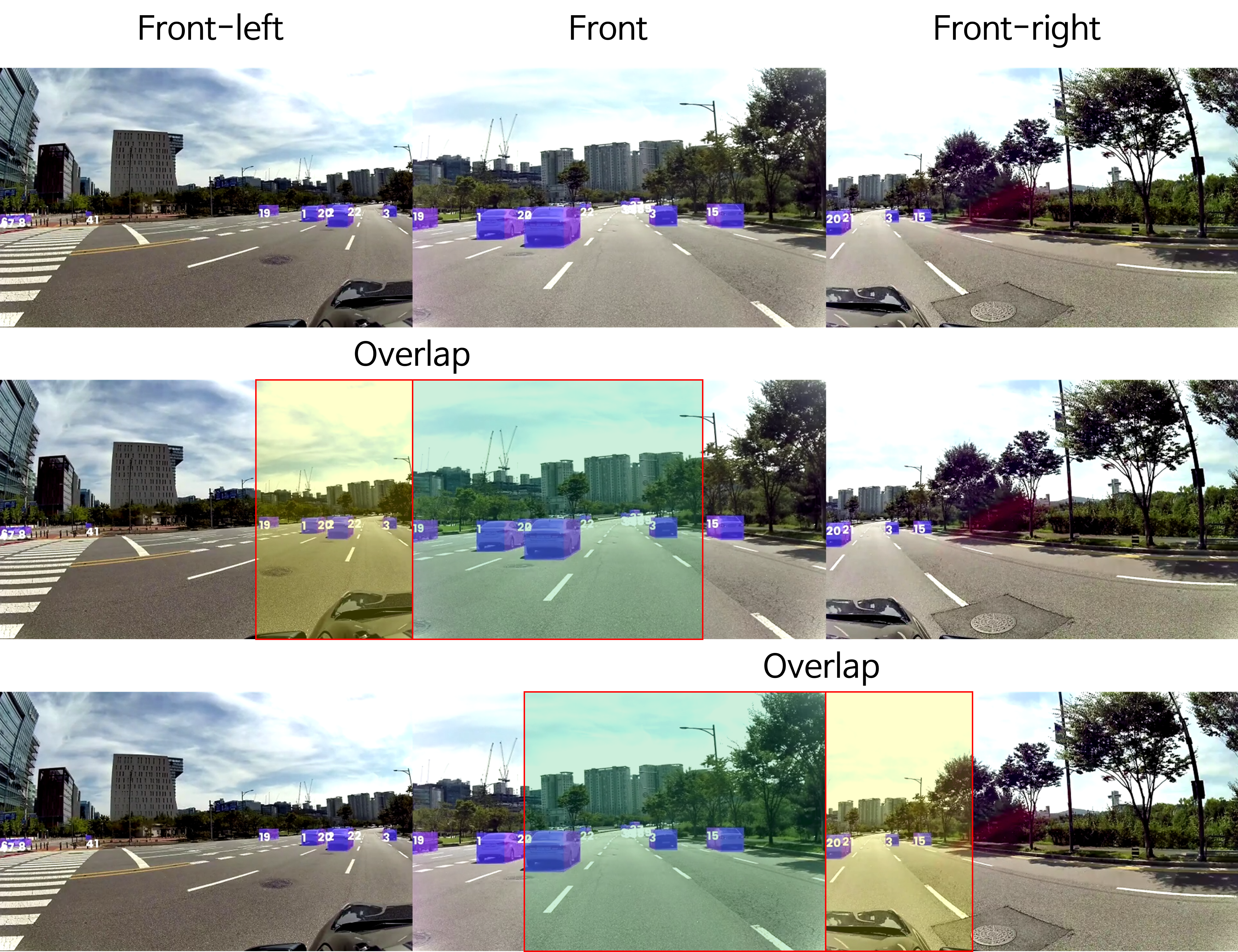

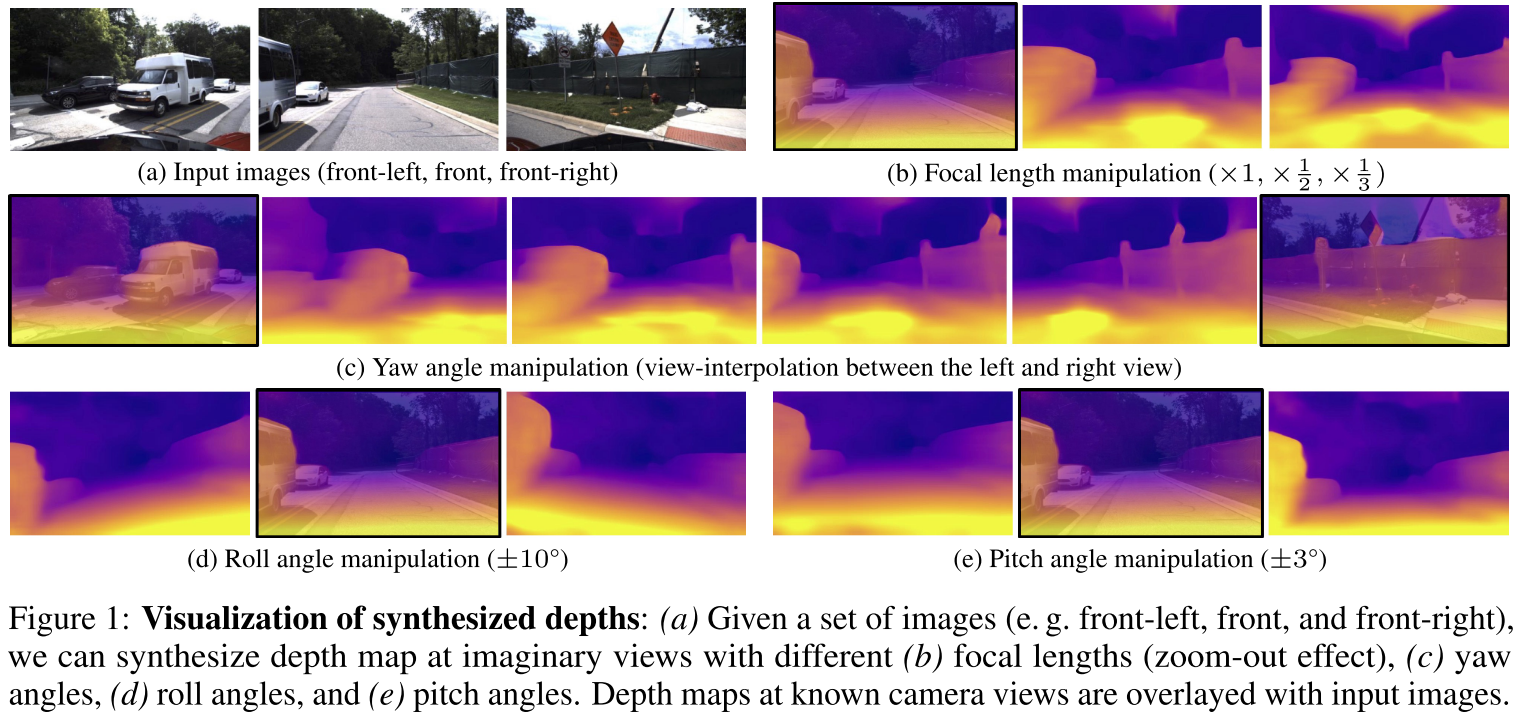

- 본 논문에서는

front,front-left,front-right에 대한 시각화 사례가 있었는데, 42dot 데이터셋을 보면front,front-left,front-right을 사용한 것을 볼 수 있습니다. 링크의 설명은 보면front는 60도 화각의 카메라이며front-left,front-right는 120도 화각의 카메라임을 알 수 있습니다. - 아래는

volumetric feature fusion을 한 영역으로 추정되는 영역을 표시하였습니다.